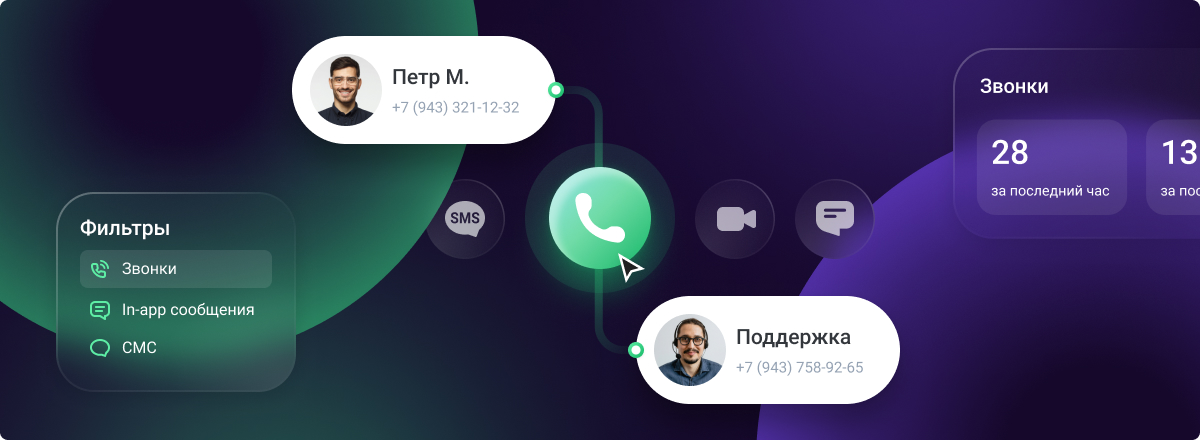

Мы занимаемся облачными real-time коммуникациями и последние несколько лет наблюдаем активное развитие голосовых ботов, которые разговаривают с людьми на естественном языке. Сегодня эти технологии повсеместно применяются крупным бизнесом для общения с клиентами — банками, авиалиниями, интернет-магазинами. В этой статье рассмотрим, что изменилось с момента появления первого ассистента восемь лет назад.

Популярные ассистенты

Siri. В 2011 году массовое распространение получил ассистент от Apple, интегрированный в iPhone 4S. На тот момент Siri умела взаимодействовать с 12 приложениями, включая напоминания, погоду, карты, электронную почту и календарь. Впоследствии список навыков расширился, и Siri стала умным устройством для всех продуктов Apple.

Прорыв компании Nuance в технологии распознавании речи, использованной для Siri, стал толчком к развитию индустрии голосовых помощников.

Google Assistant. В 2012 году появился сервис Google Now, который спустя четыре года был доработан до Google Assistant и Google Home. Компания сделала ставку на поиск ботом информации в Сети и на работу с собственными облачными сервисами, а затем и с операционной системой Android.

Cortana. Помощник для персональных компьютеров от Microsoft вышел на рынок в 2013 году, позже технология была распространена на Xbox.

Alexa. Amazon выпустил умного ассистента в 2014 году, взяв курс на создание отдельных устройств c встроенной Alexa. С их помощью компания, являющаяся мировым лидером в сегменте eCommerce, позволила людям покупать товары быстрее и проще.

Алиса. Российская разработка от компании Яндекс была представлена в октябре 2017 года. Сначала Алиса была добавлена в браузер, а прошлым летом стала «мозгом» Яндекс.Станции.

Ни один из крупных игроков индустрии не хотел отставать, видя большой потенциал в технологии.

Развитие: software и hardware

В первом случае мы говорим о навыках, встроенных вендором или добавленных другими сервисами через открытый API. С присоединением внешних разработчиков к развитию ассистента существенно растет список его умений и расширяется экосистема. Например, интеграция приложения для прослушивания музыки Spotify с Google-помощником позволяет выходить за рамки списка композиций Google Music.

Кроме того, постоянно ведется работа над улучшением качества синтеза и распознавания речи, а также над определением разных голосов. Последнее полезно для умных колонок: например, я могу попросить включить любимую музыку, и условный Google Home откроет именно мой плейлист, а не другого члена семьи.

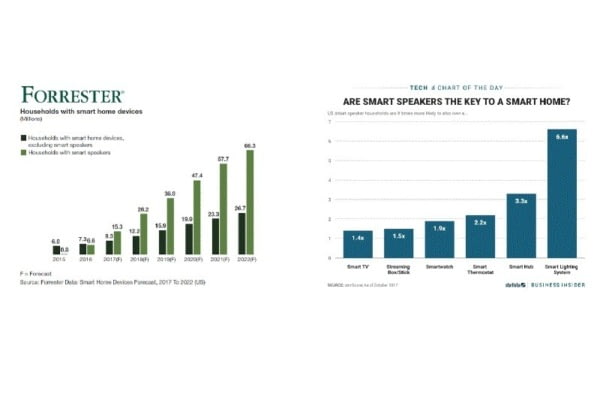

Второе направление развития — аппаратное обеспечение. Изначально голосовые помощники появились в смартфонах. Затем боты стали помогать работать с персональными компьютерами и, наконец, колонками. Последние стали необходимым звеном в экосистеме умного дома — интерфейсом, позволяющим управлять другими девайсами. Так, исследование Forrester демонстрирует прямое влияние распространения умных колонок на рост сектора IOT в целом.

Рынок умных устройств. Forrester 2017

Плюсы голосовых помощников

- Поддерживают натуральный язык общения. С ассистентом мы можем говорить почти так же, как друг с другом.

- Удобны для заказа товаров и услуг. Это справедливо только для ситуаций с небольшим числом вариантов выбора. Например, при заказе пиццы бот перечислит несколько видов, на одном из которых мы остановимся — это будет быстро. Но очевидно, что никто не стал бы прослушивать список, состоящий из 100-200 позиций.

- Ориентируются на контекст. Помощник учитывает множество данных для улучшения качества работы, включая информацию, которую уже знает о вас. Лидером здесь является Google благодаря массиву данных о пользователе, который ассистент имеет в распоряжении. Amazon же знает вашу историю покупок, поэтому Alexa может заказать молоко «как в прошлый раз».

- Поддаются обучению. Помощника всегда можно обучить дополнительным навыкам — в разумных пределах.

Минусы голосовых помощников

- Распознавание речи все еще не идеально. Особенно это касается шумных помещений или ситуаций, когда говорят несколько людей одновременно. Эти проблемы решают на уровнях как программного обеспечения, так и «железа». Например, умные колонки оснащаются минимум 4-5 микрофонами, один из которых фильтрует шум и один — эхо.

- Голос звучит не совсем естественно. Несмотря на это, синтез речи становится всё качественнее: если пять лет назад голос в IVR был механическим, то сейчас благодаря машинному обучению и нейронным сетям происходит существенный прорыв. Так, технология WaveNet от Google позволяет тренировать бота с помощью записей голоса живого человека, делая синтез практически неотличимым от естественной речи с ее паузами, интонациями, вдохами и выдохами.

- Общение с ассистентом отличается от человеческого. Перебить бота или дополнить слова жестами пока не получится: условная Алиса принимает запрос, распознает его и пытается выполнить задачу, если же в это время загружать ассистента новой информацией, процесс мышления может быть сбит. Неразрешимых технических задач нет, но такие доработки требуют времени.

- Неработоспособность без интернета. Сегодня интернет есть практически везде, но в его отсутствие умный ассистент становится довольно глупым, работая лишь с локальными данными.

- Ограниченный набор функций. Над расширением навыков ассистентов сейчас трудятся практически все разработчики, связанные с голосовым искусственным интеллектом.

На заметку

Пока остается нерешенным вопрос приватности информации. Умные устройства записывают нашу речь и окружающие звуки, а эти данные могут заинтересовать органы правопорядка. На настоящий момент нет общепринятой практики, как обладатель баз данных должен себя вести при запросе от властей: так, Amazon в некоторых кейсах отказывал в предоставлении информации, в других — шел на сотрудничество.

Что нас ждет в будущем

- Более глубокая интеграция ассистента с умным домом.

- Проактивность. То есть потенциальная способность ассистента обращаться к вам самостоятельно. Скорее всего, это будет опционально, но если бот умный, почему бы ему не начать разговор первым.

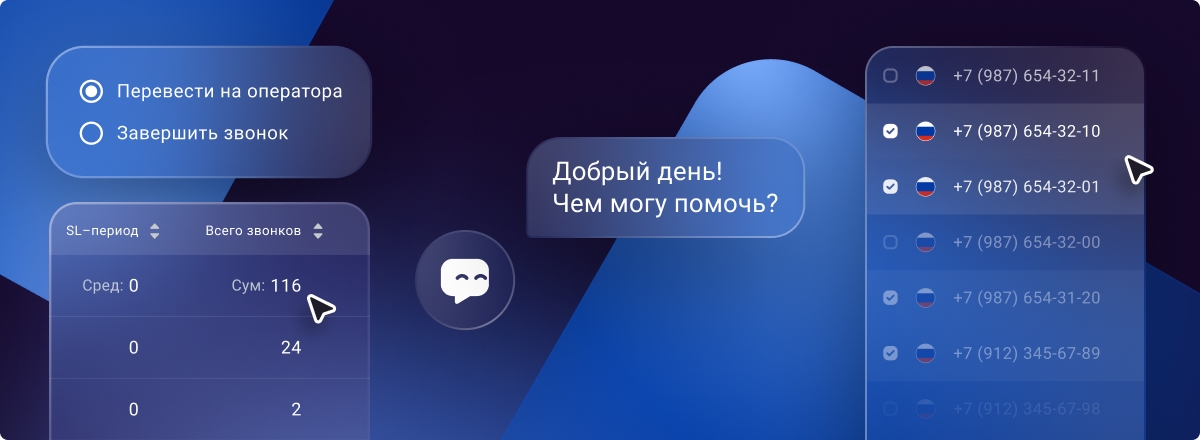

- Определение эмоций. Например, если пользователь разговаривает раздраженно, ассистент сможет поменять алгоритм работы. Эти разработки будут активно применяться как в случае голосовых помощников, так и в B2B-кейсах — а именно для виртуальных операторов колл-центров.

- Развитие нейронных сетей и моделей. Это постоянный процесс, который открывает всё большие перспективы для применения помощников.

- Визуализация. Когда голосовой интерфейс неудобен — например, при выборе из множества позиций — возникает запрос на визуальное сопровождение. Вопрос, как именно это будет реализовано, пока открыт. Вероятнее всего, в будущем мы увидим голограмму помощника или умный экран.